Pourquoi l’AI Act change la donne pour les équipes RH ?

L’AI Act modifie profondément la manière dont les directions RH peuvent utiliser l’intelligence artificielle : recrutement, évaluation, formation ou gestion des talents sont désormais encadrés par des règles précises visant à protéger les droits des collaborateurs.

L’Union européenne a adopté une réglementation inédite : l’AI Act, premier cadre légal mondial consacré à l'usage de l’intelligence artificielle. Son ambition est claire : protéger les droits fondamentaux des citoyens tout en créant un environnement d’innovation responsable.

Si toutes les entreprises sont concernées, les directions des ressources humaines sont particulièrement en première ligne. Les outils qu’elles utilisent pour recruter, évaluer ou gérer les talents sont directement visés par cette nouvelle législation.

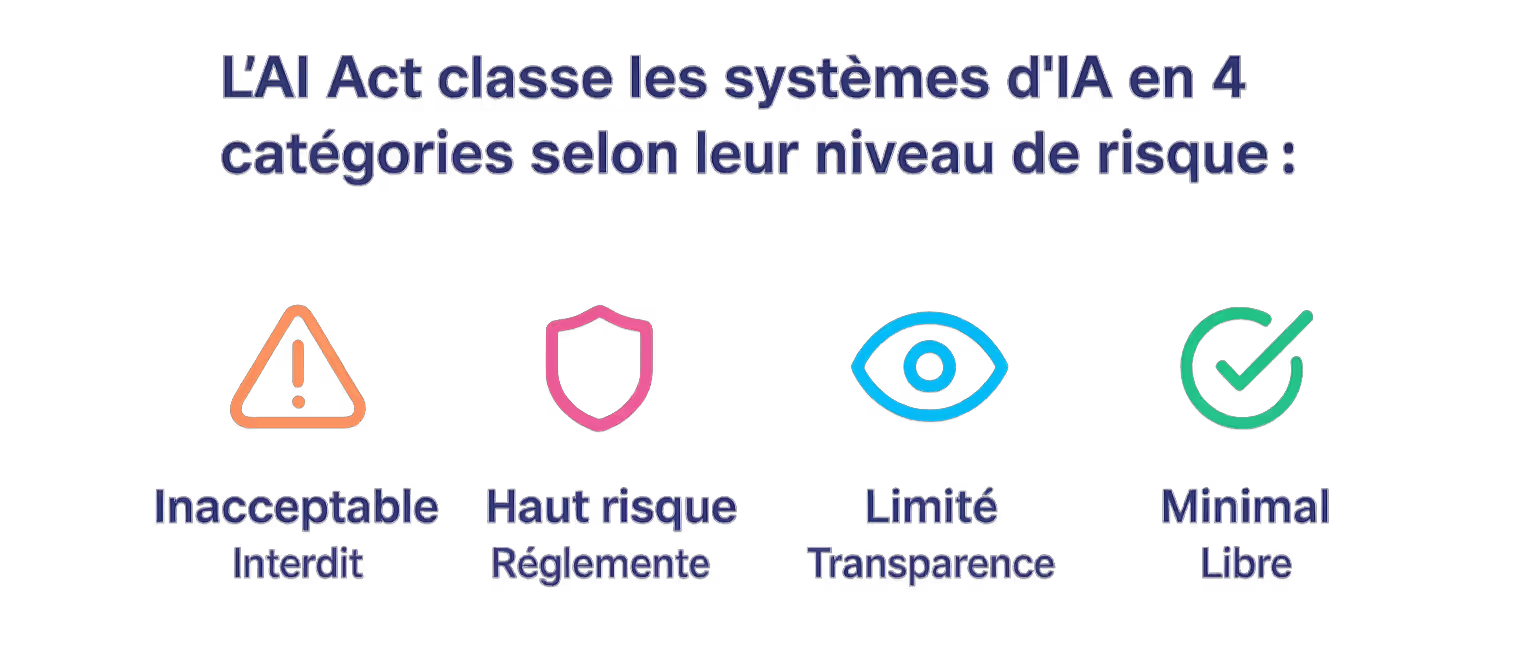

Une approche inédite : classer l’IA par niveaux de risque

L’AI Act introduit une grille d’évaluation simple mais structurante : chaque usage de l’IA est classé en fonction du niveau de risque qu’il fait peser sur les individus.

- Risque inacceptable → interdit : ex. manipulation cognitive, notation sociale, exploitation de vulnérabilités.

- Haut risque → strictement encadré : ex. recrutement automatisé, reconnaissance biométrique, scoring de performance.

- Risque limité → soumis à transparence : ex. chatbots, IA générative appliquée à la formation.

- Risque minimal → libre : ex. filtres anti-spam, outils de productivité.

Cette classification permet aux organisations de prioriser leurs efforts de conformité en fonction de la sensibilité des usages.

Les RH au cœur de l’AI Act

Pourquoi les RH sont-ils particulièrement concernés par l’AI Act ?

Parce que la fonction RH touche directement aux droits fondamentaux des individus. Les usages liés au recrutement, à l’évaluation des performances ou à la gestion de carrière sont classés comme “hauts risques” par le règlement. Ils nécessitent donc un encadrement strict, une supervision humaine renforcée et une documentation complète.

La collaboration RH et équipes SI dans le cadre de la réglementation sur l’IA

La conformité à l’AI Act n’est pas seulement un enjeu juridique ou organisationnel. Elle repose aussi sur des fondations techniques solides, l'IA transforme le SI des entreprises. C’est pourquoi la collaboration entre RH et équipes SI indispensable :

- Les RH définissent les usages et garantissent leur alignement avec les pratiques managériales et le dialogue social.

- Les SI assurent la qualité et la sécurité des données, la traçabilité des algorithmes et la mise en place d’outils d’audit.

Ensemble, ces deux fonctions bâtissent une gouvernance de l’IA équilibrée, à la fois humaine et technologique.

Quel rôle joue la supervision humaine dans les processus RH ?

L’AI Act impose que les décisions ayant un impact direct sur la carrière ou les droits d’un salarié ne soient jamais totalement automatisées.

Cela signifie qu’un humain doit rester en mesure de :

- valider ou corriger la décision de l’IA,

- détecter les biais ou erreurs éventuels,

- assumer la responsabilité finale en cas de contestation.

La supervision humaine devient ainsi une garantie de transparence, mais aussi un facteur de confiance pour les collaborateurs.

Des sanctions financières lourdes

L’AI Act ne se limite pas à des obligations théoriques : il prévoit des amendes comparables, voire supérieures, à celles du RGPD.

- Jusqu’à 35 millions d’euros ou 7 % du CA mondial pour l’usage de pratiques interdites.

- Jusqu’à 15 millions ou 3 % du CA pour des manquements liés aux systèmes à haut risque.

- Jusqu’à 7,5 millions ou 1,5 % du CA pour les autres violations.

Ce système, basé sur le montant le plus élevé entre somme fixe et pourcentage, signifie que PME et ETI sont tout autant concernées que les grands groupes.

Les échéances clés à retenir

Quelles sont les principales étapes d’application de l’AI Act ?

Les principales étapes dans l'application de la réglementation européenne sont :

- Août 2024 : entrée en vigueur officielle.

- Février 2025 : interdiction des pratiques inacceptables + obligation de formation/sensibilisation.

- Août 2025 : obligations renforcées pour les modèles fondationnels (IA génératives).

- Août 2026 : application complète pour les systèmes à haut risque (audits, certifications).

Août 2024 : l’AI Act entre officiellement en vigueur

L’adoption du règlement marque le début de la période de transition. Les entreprises doivent initier leur démarche de mise en conformité et commencer à identifier les cas d’usage IA présents dans leurs processus.

Février 2025 : premières interdictions et obligation de formation

Deux volets deviennent effectifs :

- Pratiques interdites : IA à risque inacceptable (ex. analyse des émotions pour recruter).

- Formation & sensibilisation : obligation pour les entreprises de développer une littératie IA au sein des équipes exposées à ces outils.

Août 2025 : encadrement des modèles fondationnels

Les IA génératives et modèles de type GPT, Claude ou Llama sont soumis à des règles spécifiques : transparence renforcée, documentation technique obligatoire et précisions sur la génération de contenus.

Août 2026 : application complète

Toutes les obligations liées aux systèmes à haut risque deviennent effectives :

- conformité technique stricte,

- audits réguliers et certifications,

- sanctions en cas de non-respect.

Pour les RH, l’enjeu est d’anticiper dès maintenant plutôt que d’attendre la dernière échéance avant un déploiement des IA sélectionnées.

Comment se préparer dès aujourd’hui à l'AI Act ?

Entrer en conformité avec cette réglementation ne doit pas être vécu comme une contrainte isolée, mais comme une démarche structurante pour l’entreprise.

Nous recommandons de superviser 5 étapes essentielles :

- Cartographier vos usages IA : recrutement, évaluation, chatbots, génération de contenus…

- Évaluer le niveau de risque selon la grille de l’AI Act.

- Négocier la responsabilité avec vos prestataires : même avec un outil externe, l’entreprise reste responsable devant la loi.

- Mettre en place une supervision humaine sur les processus critiques.

- Former vos équipes RH à la littératie IA (comprendre les biais, limites et implications éthiques).

Transformer la conformité en avantage compétitif

Plutôt que d’y voir une simple obligation, l’AI Act peut devenir une opportunité stratégique :

- rassurer candidats et collaborateurs grâce à des processus transparents,

- renforcer la marque employeur en affichant une démarche responsable,

- bâtir une gouvernance IA solide, qui évite les projets hasardeux et mise sur des usages à forte valeur ajoutée,

- remettre les talents au centre, plutôt que de déléguer leur gestion à des algorithmes opaques.

La conformité devient alors un levier de différenciation et de confiance sur le marché de l’emploi.

Conclusion : contrainte ou catalyseur ?

L’AI Act marque un tournant historique : l’IA entre dans une phase de régulation comparable à celle qu’a initiée le RGPD pour les données personnelles.

Pour les RH, le défi est clair : agir dès aujourd’hui, auditer ses pratiques, dialoguer avec ses prestataires et sensibiliser ses équipes.

Mais c’est aussi une opportunité unique de montrer que l’IA peut être un allié des talents, au service d’un développement responsable et équitable.